Ollama — 本地大模型运行工具

已验证 热门

本地大模型运行工具

开源 免费 本地部署 命令行 多模态 Windows ARM64 模型管理

关于 Ollama

Ollama是开源的本地大模型运行工具,让用户可在个人电脑上运行各种开源大语言模型。2026年新增Windows ARM64原生支持,支持多模态模型,提供简单命令行界面和API接口。支持Qwen2.5-72B、DeepSeek-Coder-V2、Llama-3.3等热门模型,是本地AI部署的首选工具。

Ollama 功能亮点

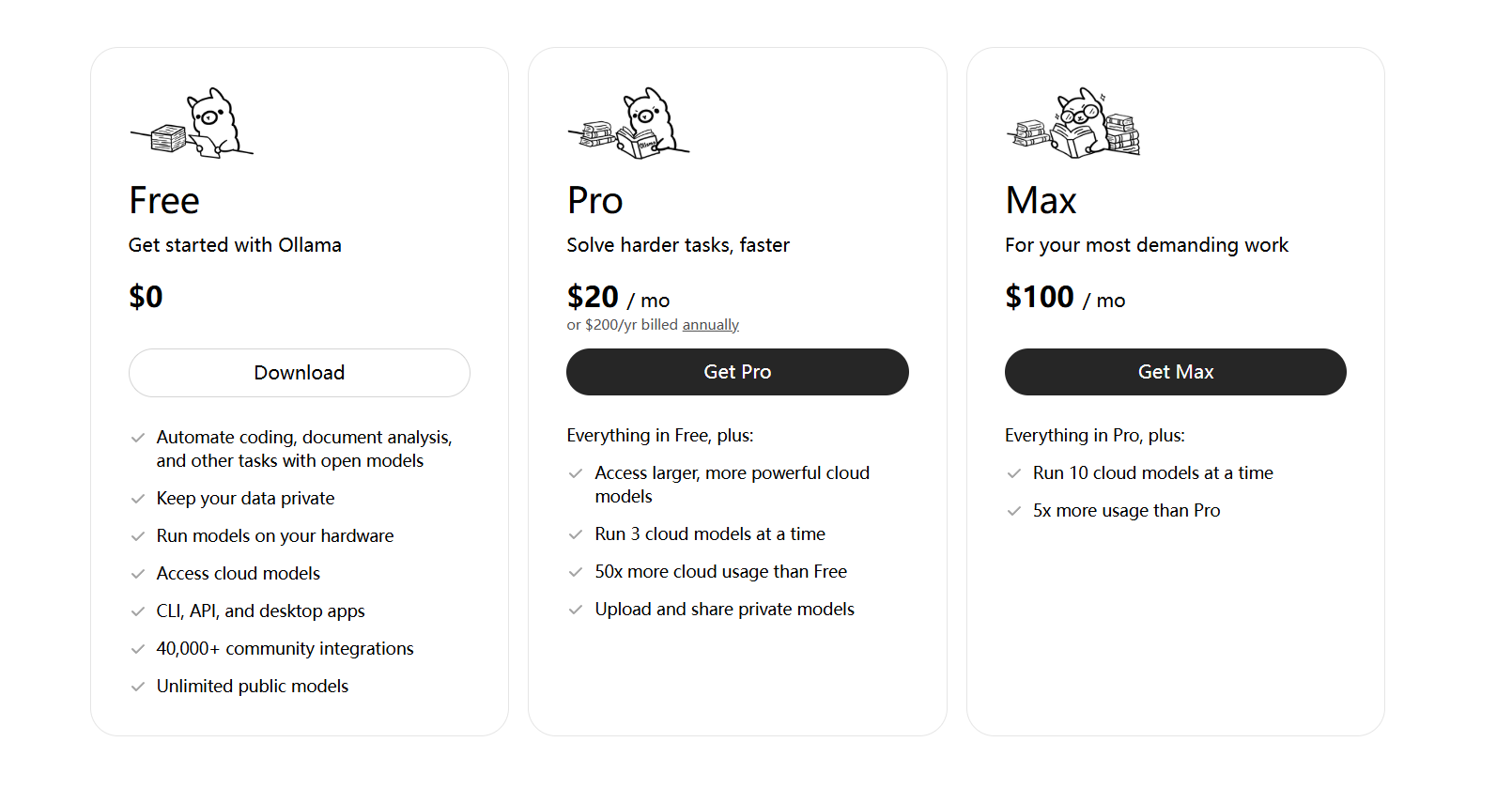

- 完全免费

- 开源

- 支持多模型

- 隐私保护

- Windows ARM64支持

- 多模态模型支持

Ollama 优缺点分析

优点

- + 完全免费

- + 开源

- + 支持多模型

- + 隐私保护

- + Windows ARM64支持

- + 多模态模型支持

缺点

- - 需要硬件

- - 配置复杂

- - 性能依赖硬件

支持平台

💻 WINDOWS

💻 MAC

💻 LINUX

常见问题 FAQ

Ollama 是免费的吗?

是的,Ollama 是完全开源免费的本地大模型运行工具。用户只需准备硬件设备,软件本身和模型下载均免费。

Ollama 支持哪些模型?

Ollama 支持 Qwen2.5-72B、DeepSeek-Coder-V2、Llama-3.3 等热门开源模型,持续增加对新模型的支持。

Ollama 需要什么硬件配置?

运行 7B 模型建议至少 16GB 内存和 8GB 显存。运行更大模型需要更强的硬件。2026年新增 Windows ARM64 原生支持。

Ollama 和 vLLM 有什么区别?

Ollama 面向个人用户,使用简单,适合本地体验。vLLM 面向生产环境,性能更高,适合企业部署。

Ollama 支持多模态模型吗?

是的,2026年 Ollama 已支持多模态模型,可以处理图片和文本的混合输入。