Groq vs vLLM:2026年全面对比

详细对比Groq和vLLM的功能、价格、优缺点,帮你选择最适合的AI工具。

一句话结论

综合来看,Groq在整体表现上略胜一筹,但vLLM在某些方面也有其独特优势。

详细对比

| 对比维度 | Groq | vLLM |

|---|---|---|

|

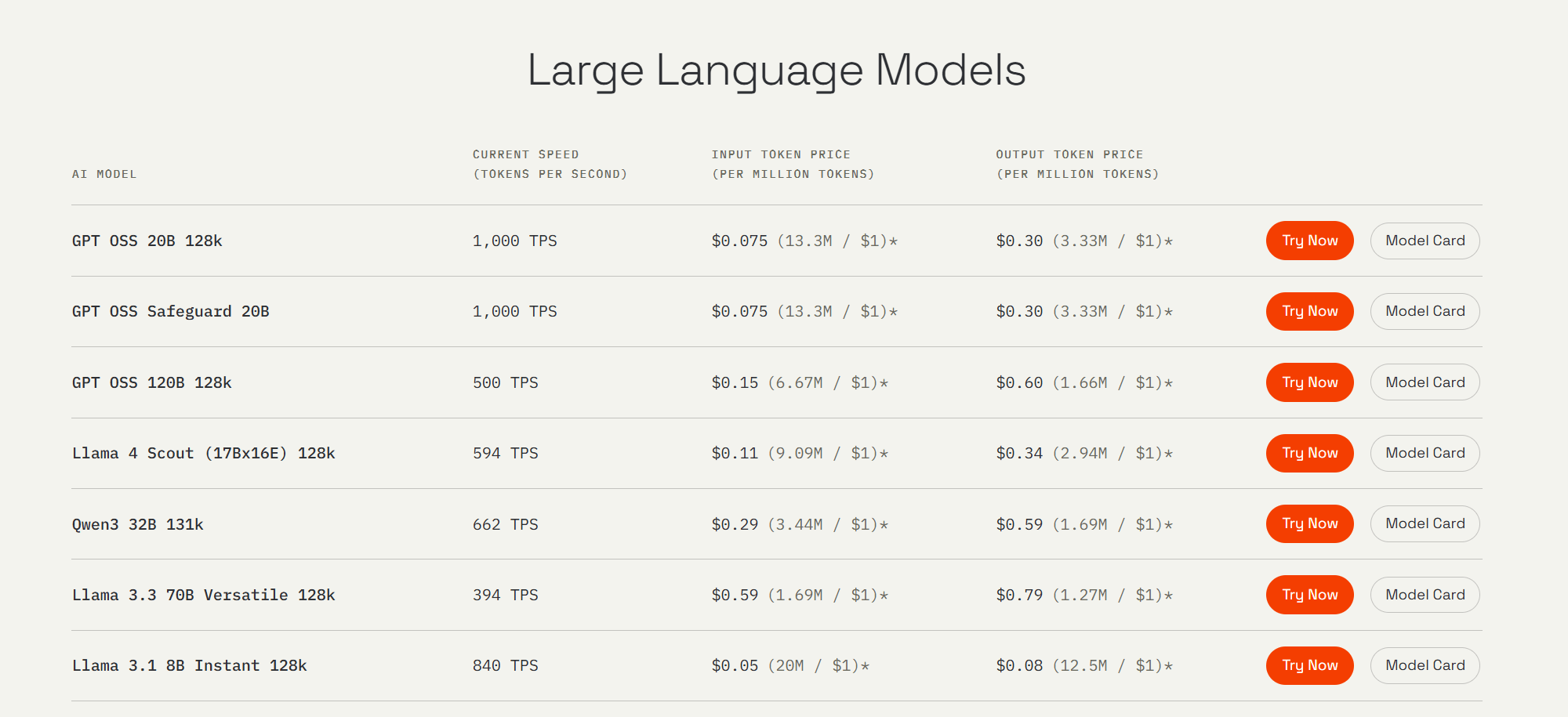

价格/定价

| 免费+付费 $0.05-$0.79/M tokens | 完全免费 ¥0 |

|

定价详情

|  | |

|

用户评分

| 4.6 (198评价) | 4.5 (189评价) |

|

适用场景

| coding api-development real-time-chat batch-processing | research coding |

|

支持平台

| 网页版 api | Linux |

|

API支持

| 支持 | 支持 |

|

支持语言

| 英文 | 英文 |

|

优缺点

| 优点

缺点

| 优点

缺点

|

Groq 的优势

Groq是一款LPU极速推理引擎,速度与性价比之王的工具。它在coding、api-development、real-time-chat、batch-processing等方面表现出色, 获得了用户4.6分的高评价。 提供免费版本, 支持网页版等平台 ,并提供API接口便于开发者集成。

vLLM 的优势

vLLM是一款高性能大模型推理引擎的工具。它在research、coding等方面表现出色, 获得了用户4.5分的高评价。 提供免费版本, 支持Linux等平台 ,并提供API接口便于开发者集成。

最终推荐

预算有限:两款工具都提供免费版本,可以先试用后决定。

追求品质:Groq用户评分更高(4.6分),整体体验更好。

特定场景:Groq更适合coding、api-development、real-time-chat、batch-processing;vLLM更适合research、coding。

追求品质:Groq用户评分更高(4.6分),整体体验更好。

特定场景:Groq更适合coding、api-development、real-time-chat、batch-processing;vLLM更适合research、coding。

常见问题 FAQ

Groq和vLLM哪个更好?

Groq和vLLM各有优势。Groq的评分是4.6分,vLLM的评分是4.5分。综合来看,Groq在整体表现上略胜一筹,但vLLM在某些方面也有其独特优势。建议根据你的具体需求选择,可以先试用免费版本体验。

Groq和vLLM的价格对比如何?

Groq的定价策略是免费+付费,价格范围为$0.05-$0.79/M tokens。vLLM的定价策略是完全免费,价格范围为¥0。两款工具都提供免费版本,可以先试用后决定。

Groq和vLLM分别支持哪些平台?

Groq支持网页版、api。vLLM支持Linux。

Groq和vLLM哪个更适合新手?

对于新手来说,两款工具都提供免费版本,建议都尝试一下,选择更符合自己使用习惯的。此外,可以参考用户评价和使用教程来帮助选择。