Groq — LPU极速推理引擎,速度与性价比之王

已验证 热门

LPU极速推理引擎,速度与性价比之王

极速推理 LPU芯片 开源模型 免费额度 OpenAI兼容 API 低成本 高吞吐 Llama 4 GPT-OSS Qwen3 DeepSeek Whisper NVIDIA收购 190万开发者

关于 Groq

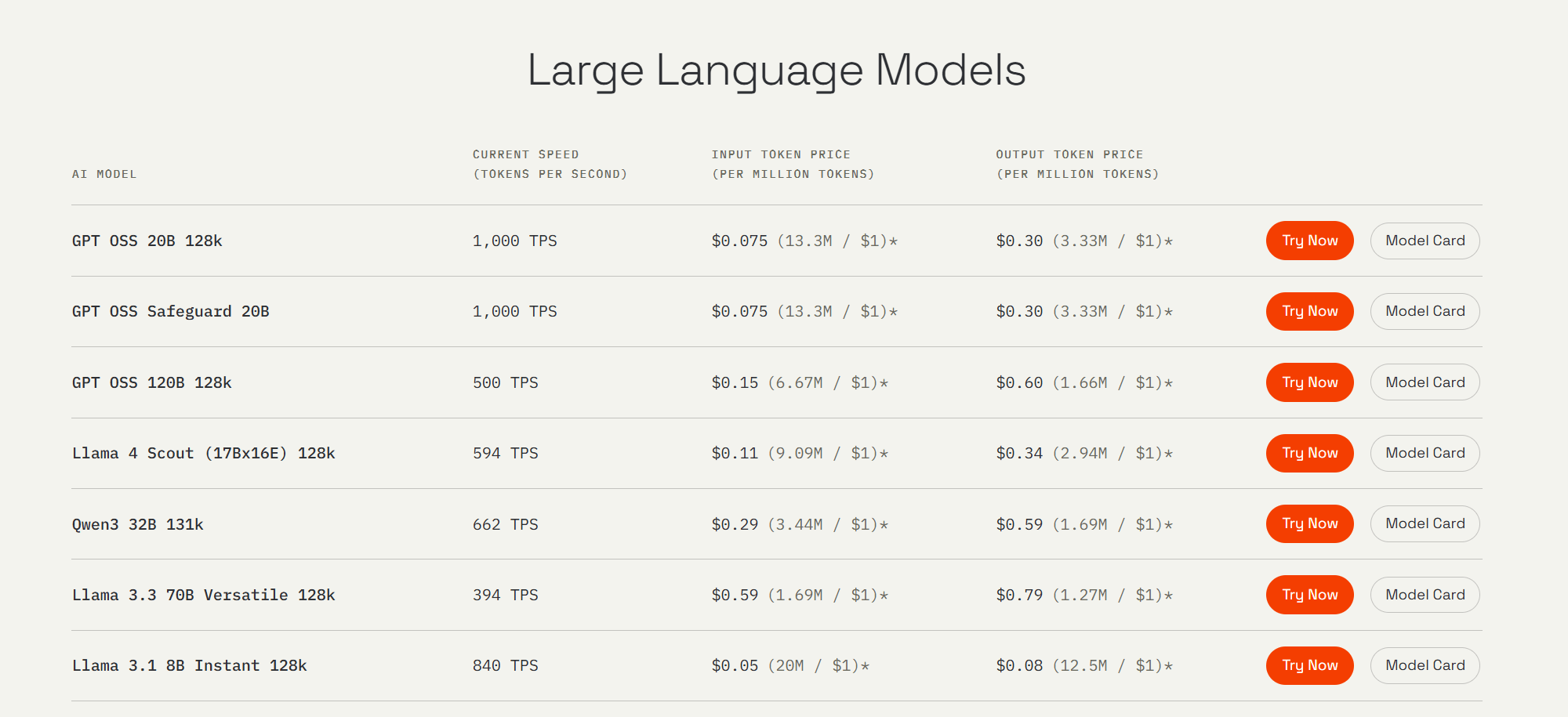

Groq是自2016年起专注AI推理的硬件公司,其自研Language Processing Unit(LPU)架构在推理速度上远超传统GPU。GroqCloud平台运行Llama 4、GPT-OSS、Qwen3、DeepSeek、Whisper等主流开源模型,推理速度可达1000+ tokens/秒(如GPT-OSS 20B达1000 TPS,Llama 3.1 8B达840 TPS),比NVIDIA H100集群快10倍。采用OpenAI兼容API,仅需两行代码即可接入。提供免费额度、Batch API(50%折扣)和内置工具(搜索、代码执行、浏览器自动化)。2025年底NVIDIA以约,进一步巩固其推理芯片领域地位。服务McLaren F1车队、Dropbox、Volkswagen等企业,开发者超190万。

Groq 功能亮点

- 推理速度极快(1000+ TPS),远超GPU方案

- 价格极具竞争力(Llama 3.1 8B仅.05/.08/M tokens)

- OpenAI兼容API,迁移成本极低

- 免费额度慷慨,所有模型免费可用

- 支持Llama 4、GPT-OSS、Qwen3、DeepSeek等主流开源模型

- 提供Batch API半价优惠

- 内置搜索、代码执行、浏览器自动化工具

- 企业级客户包括McLaren F1、Dropbox、Volkswagen

Groq 优缺点分析

优点

- + 推理速度极快(1000+ TPS),远超GPU方案

- + 价格极具竞争力(Llama 3.1 8B仅.05/.08/M tokens)

- + OpenAI兼容API,迁移成本极低

- + 免费额度慷慨,所有模型免费可用

- + 支持Llama 4、GPT-OSS、Qwen3、DeepSeek等主流开源模型

- + 提供Batch API半价优惠

- + 内置搜索、代码执行、浏览器自动化工具

- + 企业级客户包括McLaren F1、Dropbox、Volkswagen

缺点

- - 免费额度有速率限制

- - 模型选择相对有限(不支持自训练模型)

- - 部分模型仅企业可用

- - 需要科学上网

- - 无多模态(图像输入)支持

Groq 适用场景

支持平台

🌐 WEB

💻 API

常见问题 FAQ

Groq 的推理速度有多快?

Groq的LPU架构可实现1000+ tokens/秒的推理速度(如GPT-OSS 20B达1000 TPS,Llama 3.1 8B达840 TPS),比NVIDIA H100集群快约10倍。这是通过确定性执行和片上SRAM架构实现的。

Groq 的价格是多少?

Groq采用按token计费,价格极具竞争力:Llama 3.1 8B仅.05/.08/M tokens(输入/输出),GPT-OSS 20B为.075/.30/M tokens,Llama 3.3 70B为.59/.79/M tokens。另有Batch API可享50%折扣。

Groq 免费吗?

是的,Groq提供免费额度,所有模型均可免费使用,但有速率限制。免费额度适合开发和测试,生产环境建议升级Developer或Enterprise tier以获得更高速率限制和折扣。

Groq 支持哪些模型?

GroqCloud支持Llama 4 Scout、Llama 3.3 70B、Llama 3.1 8B、GPT-OSS 120B/20B、Qwen3 32B、DeepSeek R1、Whisper V3 Large/Turbo等主流开源模型,以及Compound AI系统和内置工具。

Groq 和 Together AI 或 Fireworks 相比如何?

Groq在推理速度方面遥遥领先(LPU专用硬件),价格与Together AI相当但速度更快。Together AI模型选择更丰富。Groq适合对延迟敏感的应用场景,Together AI适合需要更多模型选择的场景。

Groq 的 API 兼容 OpenAI 吗?

是的,Groq提供OpenAI兼容API,仅需修改base_url为https://api.groq.com/openai/v1,即可将现有OpenAI代码迁移到Groq,迁移成本极低。

工具信息

- 定价

- 免费+付费

- API

- 支持

- 语言

- en